Hadoop - 호튼웍스 (hortonworks) HDP 설치 1

Hadoop - 호튼웍스(hortonworks) HDP 설치 1

Hortonworks Data Platform(HDP)은 분산 스토리지 및 대규모 멀티 소스 데이터 세트 처리를 위한 오픈소스 프레임워크입니다. HDP는 고객의 IT 인프라를 현대화하고 클라우드 또는 온프레미스에서 데이터 보안을 유지하는 한편, 새로운 매출 흐름을 주도하고 고객 경험을 개선하며 비용을 제어할 수 있도록 지원합니다.

HDP는 민첩한 애플리케이션 배포, 머신러닝 및 딥러닝 워크로드, 실시간 데이터 웨어하우징, 보안, 거버넌스를 지원합니다. 이는 미사용 데이터를 한 현대적 데이터 아키텍처의 핵심 구성요소입니다.

2016년도 어떠한 계기로 인해 하둡에 대해 아무것도 모르던 내가 hadoop 플랫폼에 가장 유명한 cloudera와

hortonworks 중에 hortonworks를 공부하게 되었다.

그때는 빅데이터 얘기가 업체에서도 많았고 사용하고자 하는 업체도 많았다.

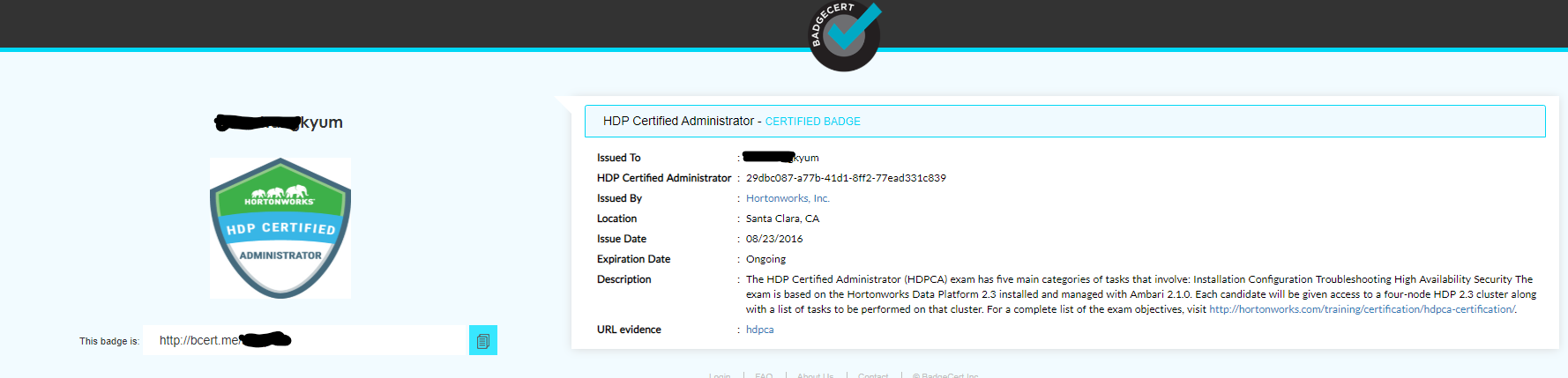

결국엔 HDPCA(HDP Certified Administrator)를 취득하게 되었다.

이제 저 업무를 하지 않다보니 필요가 없어졌다.

그래서 까먹지 않으려고 블로그에 작성하니 필요한 분에게는 도움이 됐으면 좋겠다.

요즘에는 업체와 일을 하다 보면 hadoop을 사용하는 것이 틈틈이 보인다 apache hadoop은 오픈소스이다.

오픈소스이기 때문에 hortonworks 역시 무료 설치 가능하다. 하지만 기술적인 issue 및 troubleshooting을 위해서는

hortonworks를 비싼 돈 주고 연마다 구독하여야 한다.

우리는 설치 시 ambari를 통해 설치할 것이다.

ambari는 프로비저닝, 관리, 모니터링 및 보안을 위한 오픈 소스 관리 시스템이다.

무료 설치 가능하니 오늘은 간단히 어떻게 진행되어야 하는지 맛만 봐보도록 하자.

software requirements

- yum + rpm (redhat, centos)

- apt (debian, ubuntu)

- scp

- curl

- unzip

- tar

- wget

- openssl

- python

memory requirements

Number of hostsMemory AvailableDisk Space

| 1 | 1024 MB | 10 GB |

| 10 | 1024 MB | 20 GB |

| 50 | 2048 MB | 50 GB |

| 100 | 4096 MB | 100 GB |

| 300 | 4096 MB | 100 GB |

| 500 | 8096 MB | 200 GB |

| 1000 | 12288 MB | 200 GB |

| 2000 | 16384 MB | 500 GB |

위에 최소사양은 저러하며 더 있지만 굳이 기입할 필요가 없을 듯하여 여기까지만 쓰도록 하겠다.

그리고 HDP의 구성은 대략 이러하다.

ambari를 통해 HDP설치하기 위해 필요한 최소 준비사항은 아래와 같다.

Prepare the enviroment

- Set up password-less SSH

- Enable NTP on the cluster and on the Browser Host

- Edit the Host File

- Set the Hostname

- Edit the Network Configuration File

- Configuring iptables

- Disable SELinux and Packagekit and check the umask value

위 사항은 사실 복잡하지 않고 간단하다.

그래도 다음포스팅에 이어 prepare the enviroment안에 설치 내용을 기록해 두겠다.

HDP install 마무리는 08월 중순안까지 마무리 하도록 노력해보겠다.

'hadoop' 카테고리의 다른 글

| Hadoop - 호튼웍스(hortonworks) HDP 설치 3 (2) | 2020.08.10 |

|---|---|

| Hadoop - 호튼웍스(hortonworks) HDP 설치 2 (0) | 2020.08.01 |